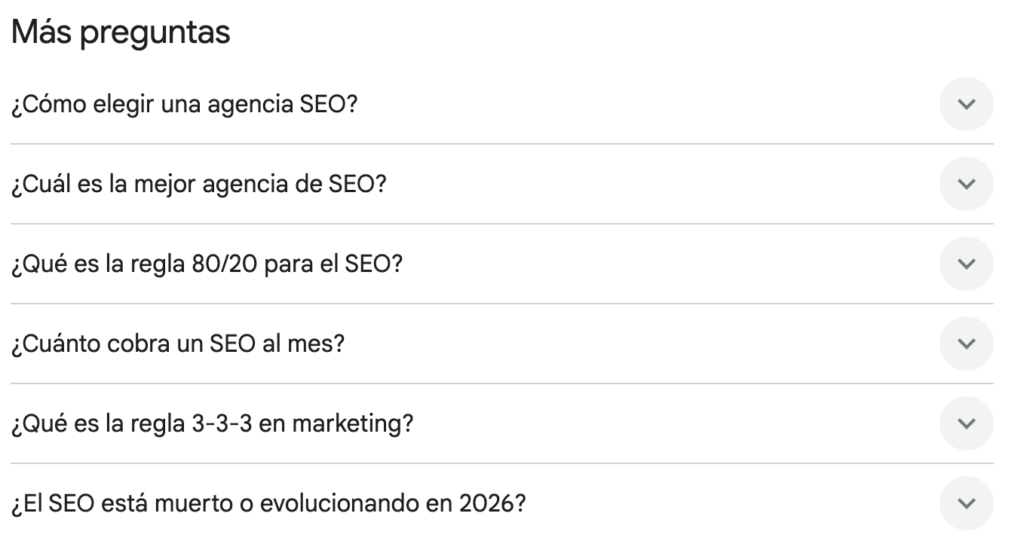

FAQs y visibilidad en IA: el formato que prefieren los LLMs

Existe un formato que llevas años usando mal, o directamente no utilizando, y que resulta parece ser exactamente lo que necesitan los sistemas de inteligencia artificial para citar tu contenido: las FAQs o Preguntas Frecuentes.

Nada de contenido largo. No los pilar posts con 5.000 palabras. No los vídeos. Las preguntas frecuentes. Ese bloque que muchos equipos de contenido tratan como relleno de pie de página, que se redacta en diez minutos antes de publicar y al que nadie vuelve a tocar nunca más.

Los LLMs (modelos de lenguaje de gran escala) como ChatGPT, Gemini, Claude o Perplexity han cambiado el modelo de visibilidad digital.

La pregunta ya no es «¿en qué posición ranqueo?», sino también»¿soy la fuente que la IA elige para responder?». Y en ese nuevo paradigma, las FAQs tienen una ventaja estructural que ningún otro formato de contenido puede igualar.

En este artículo te explicamos lo que hemos estado investigando y probando en webs de nuestros clientes y qué tienes que hacer para sacarle partido desde hoy.

Por qué la Inteligencia Artificial ha cambiado el juego del SEO

Durante más de dos décadas, el SEO ha girado en torno a posiciones, clics y tráfico orgánico. El objetivo era simple: aparecer en los primeros resultados cuando alguien hacía una búsqueda en Google. Ese modelo sigue siendo relevante, y estoy convencido de que lo seguirá siendo durante los próximos años, pero ha dejado de ser el único escenario donde compites por la atención del usuario.

Hoy he publicado en Linkedin esta publicación que creo que explica muy bien esta nueva situación en las que nos movemos los profesionales del SEO y del marketing online, en general:

Semrush publicó un análisis del flujo de clics de 17 meses de datos de uso de ChatGPT. La principal conclusión: entre el 65 % y el 85 % de las consultas de ChatGPT no tienen una palabra clave coincidente en la base de datos de Semrush . Son consultas que simplemente no existen en la búsqueda tradicional.

Mientras tanto, el tráfico de referencia saliente de ChatGPT creció un 206% interanual (enero de 2025 frente a enero de 2026), y la proporción de ese tráfico de referencia que regresaba a Google aumentó del 14% a más del 21%.

Estos datos cuantifican un problema: la mayor parte del descubrimiento impulsado por IA es invisible para las herramientas de medición existentes. Si entre el 65 % y el 85 % de las sugerencias no coinciden con ninguna palabra clave, entonces la optimización para palabras clave solo abarca una pequeña parte del potencial de tu marca.

El nuevo ecosistema digital: Búsqueda tradicional + búsqueda generativa

El crecimiento del tráfico de referencia también cambia la narrativa de que ChatGPT simplemente está canibalizando a Google. Está creando un nuevo ciclo de descubrimiento donde los usuarios alternan entre la IA y la búsqueda.

El hecho de que ChatGPT envíe una proporción cada vez mayor de su tráfico de referencia a Google sugiere que los usuarios lo consideran un punto de partida para su investigación , no un destino final.

Esto demuestra que la búsqueda con IA y la búsqueda tradicional se están convirtiendo en herramientas complementarias, no sustitutas.

Debemos entender que el los próximos años la prioridad es que nuestra web debe aparecer en ambos lugares.

- La búsqueda tradicional, donde el usuario introduce una query, obtiene una lista de enlaces y decide en qué URL hacer clic.

- La búsqueda generativa, donde el usuario formula una pregunta a ChatGPT, activa un AI Overview en Google, o consulta Perplexity, y recibe directamente una respuesta sintetizada a partir de múltiples fuentes, sin necesidad de hacer clic en ningún enlace.

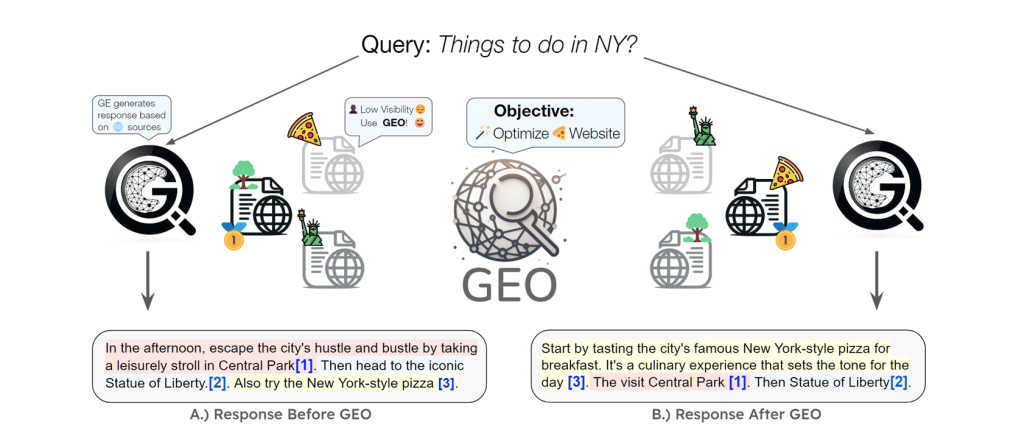

Esta segunda modalidad, que podemos llamar «búsqueda zero-click», no es marginal. Según datos recopilados por investigadores de Princeton y Georgia Tech en el paper que dio origen al término GEO (Generative Engine Optimization), los motores generativos están procesando consultas que antes acababan en Google.

El usuario que le pregunta a ChatGPT «¿cuál es la mejor agencia SEO en Barcelona?» no va a ver tu web a menos que el modelo decida mencionarte.

Adaptarse a este entorno no requiere abandonar el SEO clásico, que sigue siendo la base técnica sobre la que todo lo demás se sostiene, sino ampliar la estrategia hacia lo que los especialistas ya denominan AEO (Answer Engine Optimization) y GEO.

Y ambas disciplinas convergen en un mismo tipo de contenido: respuestas directas, bien estructuradas, verificables y fáciles de parsear. Es decir, FAQs.

Cómo «piensan» los LLMs y por qué las FAQs encajan perfectamente

Cuando un modelo de lenguaje genera una respuesta, no funciona como Google, que recorre un índice de URLs y las ordena por relevancia.

Los LLMs interpretan la intención real de la pregunta mediante procesamiento de lenguaje natural (NLP), identifican fuentes con autoridad sobre el tema, evalúan la claridad y estructura del contenido, y producen una síntesis que combina información de múltiples fuentes.

El formato FAQ encaja de forma casi perfecta con este proceso por tres razones:

1. Estructura clara para el modelo

Una FAQ bien construida sigue el esquema pregunta → respuesta → contexto. Es exactamente el patrón que los LLMs están entrenados a reconocer, procesar y reproducir.

Cuando el modelo encuentra ese patrón, el coste de extracción y síntesis es mínimo. Cuando encuentra un párrafo denso sin encabezados claros, tiene que hacer más trabajo para localizar la respuesta relevante, lo que reduce la probabilidad de que te citen.

2. Lenguaje natural alineado con las consultas reales

Las mejores FAQs no deberían estar escritas en el lenguaje interno de la empresa ni en terminología de marketing. Tendrían que estar formuladas como lo haría un usuario real al teclear en un buscador o al hablar con un asistente de IA.

Esa alineación entre la forma de la pregunta en la FAQ y la forma de la consulta del usuario aumenta significativamente la probabilidad de que el modelo establezca una correspondencia semántica y extraiga tu contenido como respuesta.

3. Respuestas autónomas de la longitud correcta

Un fragmento de entre 50 y 80 palabras que responde a una pregunta concreta sin necesitar contexto externo es ideal para ser citado en su integridad.

Los modelos pueden incluirlo en su respuesta tal cual, modificarlo ligeramente para adaptarlo al flujo de la respuesta generativa, o usarlo como fuente implícita que moldea el tono y los datos de la respuesta, aunque no se cite de forma explícita.

4. No tienes que aparecer citado para influir en la respuesta.

Este punto es muy importante. Los LLMs sintetizan patrones a partir de múltiples fuentes. Si tu FAQ forma parte del corpus de textos que el modelo procesa, está dando forma a la respuesta aunque tu marca no aparezca mencionada. Estás escribiendo para ser citado, pero también para ser la voz que da forma a lo que la IA dice sobre tu sector.

El error más frecuente: FAQs escritas para los buscadores de hace diez años

La mayoría de las FAQs que existen en webs corporativas españolas comparten el mismo problema: están optimizadas para un SEO que ya no es suficiente.

Preguntas como «¿Qué es [nombre de producto]?» seguidas de una descripción de marketing. Respuestas que insertan la keyword principal tres veces en cuatro líneas.

Bloques de FAQ que no responden a ninguna duda real, sino a lo que la empresa quiere comunicar.

Ese tipo de contenido no solo no ayuda en entornos generativos: puede perjudicar activamente la percepción de autoridad que los modelos construyen sobre tu dominio.

La IA prioriza fuentes fiables, con señales de E-E-A-T sólidas y contenido que responde preguntas reales de usuarios reales.

Deja de preguntar «¿qué queremos comunicar?» y empieza a preguntar «¿qué preguntaría alguien a ChatGPT sobre este tema?». Son preguntas diferentes y las respuestas que generan también lo son.

Cómo redactar FAQs que funcionen en AEO y GEO

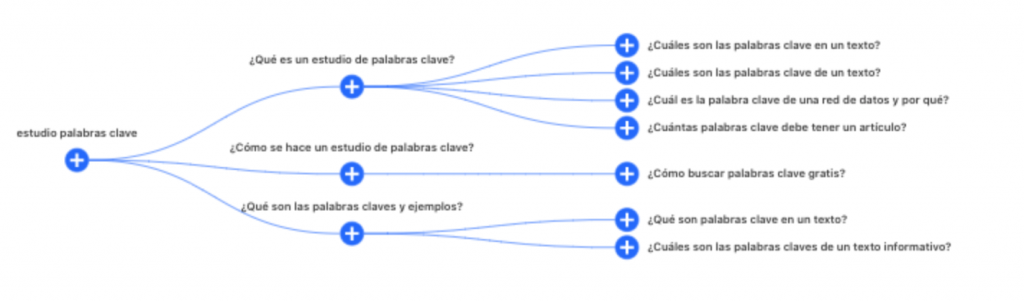

1º Define las preguntas a partir de datos reales

Antes de escribir una sola pregunta, analiza:

- People Also Ask en los resultados de Google para tus keywords principales. Son preguntas reales que el propio Google ha identificado como frecuentes.

- Búsquedas relacionadas al final de la SERP: suelen revelar intenciones informacionales no satisfechas por el contenido existente.

- Consultas conversacionales que aparecen en tu Google Search Console: queries largas con estructura de pregunta (las que contienen «cómo», «qué», «cuándo», «por qué») son candidatas directas a convertirse en FAQs.

- Foros y comunidades: Reddit, Quora, grupos de LinkedIn y foros sectoriales te muestran cómo formulan realmente sus dudas las personas interesadas en tu área.

Escribe respuestas en el rango de 60-100 palabras

Demasiado cortas (menos de 40 palabras) no aportan suficiente contexto para que el modelo evalúe la fiabilidad de la respuesta. Demasiado largas pierden la característica de unidad autónoma que hace que los LLMs puedan citarlas. El rango óptimo está entre 60 y 100 palabras por respuesta: suficiente para ser útil, lo bastante conciso para ser reproducible.

Usa lenguaje conversacional, no corporativo

La respuesta de una FAQ debe sonar como algo que un experto diría en una conversación, no como un comunicado de prensa. Frases cortas. Estructura directa. Sin tecnicismos innecesarios. Con datos y ejemplos concretos cuando la precisión lo requiere. Sin adjetivos vacíos como «líder», «innovador» o «solución integral».

Posiciona las FAQs en el lugar correcto dentro de la página

Uno de los hallazgos más relevantes que documenta el artículo original de Glenn Frates en PR Newswire es que marcas como The Hershey Company están situando las FAQs en la parte superior de sus notas de prensa por encima del boilerplate corporativo, tratándolas como contenido prioritario y no como apéndice.

La lógica es la misma que aplica en cualquier página web: el contenido más arriba en el DOM recibe mayor atención por parte tanto de usuarios como de crawlers y modelos de IA.

Si tus FAQs están enterradas al final de una página de 4.000 palabras, están compitiendo con desventaja.

Implementa el schema FAQPage correctamente

El marcado estructurado FAQPage de Schema.org no garantiza visibilidad en LLMs, los datos actuales son claros al respecto: el schema no funciona como señal directa para ChatGPT o Perplexity, pero sí tiene un efecto tangible en los resultados de Google tradicionales: activa los rich snippets de preguntas frecuentes que aumentan el espacio que ocupa tu resultado en la SERP y mejoran el CTR.

Además, al hacer el contenido más parseable para cualquier sistema automático, mejora indirectamente la probabilidad de ser procesado correctamente por los crawlers que algunos modelos utilizan para actualizar su conocimiento.

La implementación correcta. Recuerda que requiere que cada objeto Question y Answer del schema corresponda exactamente con el texto visible en la página. Los sistemas que detectan discrepancias entre el schema y el contenido real los penalizan como señal de baja fiabilidad.

El objetivo final: Influir en la IA sin ser citado

Existe una diferencia importante entre los mecanismos de visibilidad en SEO clásico y en entornos generativos.

En SEO clásico, la visibilidad es binaria: o apareces en la SERP o no apareces. Se puede medir con precisión: posición, impresiones, clics.

En entornos generativos, la visibilidad tiene un componente difuso. Un modelo que ha procesado tu contenido puede integrar tus datos, tu terminología, tus argumentos o tu perspectiva en una respuesta sin citarte explícitamente.

Estás moldeando el output de la IA aunque no aparezcas en él. Este fenómeno, que algunos investigadores denominan «narrative shaping», es muy importante para marcas en sectores donde la autoridad temática es un diferenciador competitivo.

Si tu web tiene el contenido más completo, más estructurado y más alineado con las preguntas reales de tu audiencia, te conviertes en una fuente implícita de referencia incluso cuando la IA no te menciona. A largo plazo, esto construye la consistencia semántica que hace que, cuando el modelo sí necesite citar una fuente, la tuya sea la más reconocible.

Es una lógica de inversión que va más allá del SEO de corto plazo: no escribes solo para el clic de hoy, sino para el reconocimiento de marca que la IA generaliza mañana.

FAQs en contenidos externos: el multiplicador que muchos ignoran

Las FAQs no solo deberían vivir en tu web. Cualquier contenido que publiques en canales externos: notas de prensa, artículos de colaboración, guest posts, fichas de empresa en directorios sectoriales, se convierte en una señal adicional que los modelos pueden procesar.

La estrategia que describe Glenn Frates para PR Newswire tiene implicaciones directas para la distribución de contenido: si incluyes una FAQ bien construida en una nota de prensa distribuida a través de un wire de noticias de autoridad, estás añadiendo una fuente externa que refuerza la presencia semántica de tu marca en el corpus que alimenta a los modelos.

Marcas como Synchrony han aplicado este principio situando preguntas de alto valor sobre el sector no sobre el producto, al inicio de sus comunicaciones. El resultado es que el modelo aprende a asociar a la marca con el conocimiento sobre el tema antes de asociarla con el producto específico. Es posicionamiento de marca en el sentido más literal: estás ocupando espacio mental (en este caso, del modelo) antes de que llegue la intención de compra.

Un cambio que no requiere reinventar la estrategia

Si llevas tiempo trabajando SEO con criterio: keyword research sólido, contenido alineado a intención, arquitectura de información clara, E-E-A-T trabajado, la transición hacia AEO y GEO no es un punto de partida desde cero. Es una extensión natural de lo que ya haces.

Los mismos principios que hacen que un artículo rankee bien en Google son los que hacen que un fragmento de FAQ sea elegido por un modelo generativo: relevancia para la consulta, autoridad temática demostrable, claridad de expresión y estructura que facilita la extracción de información.

Lo que cambia es el formato prioritario y el criterio de éxito. El formato prioritario son las respuestas directas y autónomas. El criterio de éxito no es solo la posición en la SERP, sino la capacidad de ser procesado, comprendido y citado en un entorno donde el usuario ya no ve la lista de resultados.

Las FAQs son la intersección perfecta entre ambos mundos. Ranquean en Google. Se adaptan a los featured snippets. Y son el tipo de contenido que los modelos de IA consumen con menos fricción.

Preguntas frecuentes sobre FAQs y visibilidad en IA

¿Las FAQs tienen algún impacto directo en el posicionamiento en ChatGPT o Perplexity?

El impacto es indirecto pero real. Los LLMs no indexan webs como Google, pero los crawlers que usan para actualizar su conocimiento priorizan contenido estructurado, claro y de fuentes con autoridad. Una FAQ bien construida e implementada con schema FAQPage aumenta la parseabilidad del contenido y mejora las señales de confianza que los modelos asocian al dominio.

¿Cuántas FAQs debería tener una página para ser relevante en entornos generativos?

No hay un número mínimo con evidencia empírica sólida, pero la práctica habitual en contenido AEO apunta a entre 5 y 10 preguntas por página. Más importante que la cantidad es que cada pregunta responda a una duda real, que las respuestas sean autónomas (comprensibles sin leer el resto del artículo) y que no se solapen entre sí.

¿Tiene sentido incluir FAQs en páginas de producto o de servicio, no solo en el blog?

Completamente. Las páginas de producto y servicio son las que mayor intención comercial tienen, y las FAQs en esos contextos abordan las dudas que bloquean la conversión. Además, son exactamente las preguntas que alguien haría a un asistente de IA antes de tomar una decisión de compra.

La presencia en esa fase del proceso es tráfico de alta calidad: el usuario que sí hace clic tras una respuesta de IA está mucho más cerca de convertir.

¿Debo reescribir todas mis FAQs existentes o solo crear nuevas?

Empieza por auditar las existentes. El criterio de revisión es simple: ¿suena esta pregunta como algo que alguien teclearía en ChatGPT? ¿La respuesta puede entenderse sin necesidad de leer el resto de la página? Si la respuesta a cualquiera de las dos es no, hay trabajo que hacer.

Tu contenido ya existe. Lo que falta es que la IA lo encuentre

La mayoría de las webs que auditamos en SEO In House tienen contenido suficiente para aparecer en respuestas generativas. El problema no es la ausencia de información: es que está mal estructurada, enterrada en párrafos densos o formulada en el lenguaje de la marca en lugar del lenguaje del usuario.

Una auditoría de contenido orientada a AEO y GEO no parte de cero. Parte de lo que ya tienes, identifica los fragmentos con mayor potencial de ser citados por un modelo de IA y los transforma en el formato que esos modelos prefieren: respuestas directas, autónomas, estructuradas y verificables.

Si quieres saber en qué posición está tu web frente a la búsqueda generativa —qué preguntas de tu sector responde la IA hoy y si tu marca aparece en esas respuestas—, podemos hacer ese diagnóstico contigo.

Contacta ahora con nuestra agencia Seo en Barcelona en el 653 030 694 y cuéntanos en qué fase está tu estrategia de contenido para ver cómo podemos ayudarte a conseguir tus objetivos. Sin compromiso.

También puedes leer:

Las SERP de Google en 2026: Qué Features dominan y cómo posicionarte en ellas

Cómo posicionar en las Vistas de IA Google y Modo IA en 2026

Optimización de Motores Generativos (GEO): La Nueva Era del SEO en 2026

17 tendencias SEO en 2026 para mejorar tu posicionamiento.